전장에는 이미 인공지능(AI)이 어떤 형태로든 사용되고 있다. 인공지능이 탑재된 로봇 킬러(Robot Killer)들이 등장하면서 국제사회는 이에 대한 강력한 규제가 필요하다는데 의견을 모아가고 있지만, 아직은 초기 단계에 머물러 있다.

이스라엘의 쉬지 않는 무차별 공격에 의한 ‘죽음의 수용소(Death Camp)’로 불리는 가자지구에서는 2023년 10월 7일 하마스의 로켓 공격으로부터 시작된 전쟁이 11개월째 접어들었다.

지난 2010년 튀르키예 앙카라는 방문한 데이비드 캐머런 영국 총리는 가자지구와 관련해 “세계에서 가장 큰 야외 감옥(World’s largest open-air prison)”이라는 말을 사용해는데, 감옥은 이제 가자지구를 표현하는데 부적절하다며 ‘게토(ghetto : 빈민가)라고 불러야 한다는 주장이 나왔다.

마샤 게센(Masha Gessen)은 뉴요커 신문에 기고한 글에서 “감옥(prison)은 팔레스타인인들이 겪는 일을 설명하는데 적합지 않다”면서 ’게토‘로 불러야 한다고 주장했다. 그는 이스라엘의 가자 공격은 나치 독일의 바르샤바 케도(Ghetto of Warsaw)와 동일하게 봐야 한다고 했다.

이어 그는 이스라엘의 가자지 공격으로 인한 인명 피해를 보면, 가자지구는 이제 트레블링카(Treblinka : 폴란드 바르샤바 인근 나치 수용소 또는 그 마을), 소비보르(Sobibor, 나치 독일의 절멸 수용소. 주블린 근처), 혹은 오시비엥침(Oswiecim : 폴란드 남부 도시 나치 강제 수용소)으로 불러야 할 정도라고 주장했다.

그렇다면 이스라엘 방위군(IDF)과 최고지도자 베냐민 네타냐후 총리의 불굴의 전투 의지만이 가자지구를 ’죽음의 수용소‘로 만들고 있을까? 정확하게 아니다.

잘 알려지지 않은 인공지능(AI) 라벤더(AI Lavender)가 이제 이스라엘군을 살해범으로 만들어 가고 있다는 주장이 설득력 있게 들린다. 가자 폭격을 지휘하는 것이 바로 ’라벤더‘라는 것이다. 이 소식이 알려지자, 이스라엘 당국은 전혀 근거 없는 소문이라고 일축했다. 하지만 깊숙이 이 일을 한 이스라엘의 요원들이 폭로한 것이어서 이스라엘 당국 주장을 그대로 믿을 수 없을 것 같다. 내용이 너무 현실적이고 구체적이다.

이스라엘군은 인간의 감독이 거의 없는 AI 타겟팅 시스템과 사상자에 대한 관대한 정책을 사용, 수만 명의 가자지구 주민을 암살 대상자로 지정한다는 것이다. 이 인공지능 라벤더는 팔레스타인 사람들을 대상으로 다양한 개인 정보, 얼굴 인식 등을 LLM(거대 언어 모델)에 의한 빅데이터를 통해 딥 러닝을 한 결과, 라벤더가 현장에서 지시하면 이스라엘군이 그 대상 인물을 살해한다는 것이다.

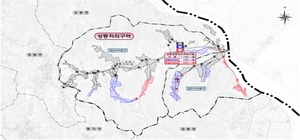

이스라엘에는 이 AI 라벤더 이외에도 건물, 시설물 등만을 식별하는 인공지능’가스펠(Gospel : 복음)’있어, 가스펠이 지시한 대로 역시 이스라엘군이 공습, 공격, 폭격을 가해 건물 등을 파괴 한다는 것이다. 라벤더와 가스펠 즉 라벤더의 향기와 좋은 소리라는 의미의 복음이라는 뜻의 이 인공지능이 가장 비인간적인 상해, 암살을 지시하는 살인 무기가 된다.

생성형 인공지능의 가장 큰 단점은 ‘환각(hallucination)’이라는 것이 있다. 할루시네이션은 ‘거짓말’을 하게 되며 AI의 신뢰성과 정확성을 훼손시키는 역할을 한다. 할루시네이션은 거대 언어 모델(LLM)과 같은 생성형 AI가 사실이 아닌 정보를 생성하거나 자신이 학습을 하지 않은 내용을 만들어내는 것을 뜻한다.

모르는 것은 모른다고 해야 하지만, 이러한 할루시네이션 현상으로 생성형 AI는 ‘죽어도 나는 모르는 것이 없다“는 식으로 사실과 다른 정보를 조합해 그럴듯한 답을 내놓는 것이다. 이것을 이용하는 전쟁터의 인간은 AI가 내놓은 내용을 팩트체크 할 겨를도 없이 AI가 시키는 대로 움직일 뿐이다.

지난 2021년에 ”인간-기계팀 : 우리 세계를 혁신할 인간과 인공지능 간의 시너지를 만드는 방법(The Human-Machine Team: How to Create Synergy Between Human and Artificial Intelligence That Will Revolutionize Our World)“라는 책이 준장 Y.S.(Brigadier General Y.S)라는 필명으로 영어로 출간됐다.

독립적인 웹사이트 +972와 로컬 콜(Local Call) 따르면, 저자는 현재 이스라엘 정예 정보부대 8200의 사령관으로 확인된 사람으로, 전쟁이 한창일 때 군사 공격을 위한 수천 개의 잠재적 목표를 생성하기 위해 엄청난 양의 데이터를 빠르게 처리할 수 있는 특수 기계를 설계해야 했다고 주장했다. 그는 그러한 기술이 ”새로운 목표물을 찾고, 목표물을 승인하기 위한 의사 결정 모두에서 인간의 병목 현상“을 해결할 것이라고 설명했다.

이 매체에 따르면, ”그런 기계가 실제로 존재한다는 것이 밝혀졌다“고 전했다. 이 매체의 새로운 조사에 따르면, 이스라엘군은 ”라벤더“라는 인공지능 기반 프로그램을 개발했으며, 이는 처음으로 공개됐다.

가자 지구에서 현재 진행 중인 전쟁 중에 군대에서 복무했으며 암살 대상을 생성하기 위해 AI를 사용하는 데 직접 관여한 6명의 이스라엘 정보 장교에 따르면, ’라벤더‘는 특히 전쟁 초기 단계에서 팔레스타인인에 대한 전례 없는 폭격에서 중심적인 역할을 했다. 소식통에 따르면, 군의 작전에 미치는 영향은 본질적으로 AI 기계의 출력을 ”마치 인간의 결정인 것처럼“ 취급할 정도였다고 한다.

공식적으로 라벤더 시스템은 하마스와 팔레스타인 이슬람 성전(PIJ=Palestinian Islamic Jihad )의 군사 조직에 있는 모든 의심 요원을 잠재적 폭격 대상으로 표시하도록 설계됐다. 여기에는 하위 계급도 포함된다. 소식통은 전쟁 초기 몇 주 동안 이스라엘 군대가 라벤더에 거의 전적으로 의존했으며, 라벤더는 37,000명에 달하는 팔레스타인인을 의심 무장 세력으로 보고 가능한 공습을 위해 그들의 집을 확인했다고 말했다.

전쟁 초기에 이스라엘 군대는 장교들이 라벤더의 사살 목록을 채택하도록 전면적으로 승인했으며, 기계가 왜 그런 선택을 했는지 철저히 확인하거나 그 선택의 근거가 되는 1차 정보 데이터를 검토할 필요는 없었다.

한 출처에 따르면, 인간 인력은 종종 기계의 결정에 대한 ’고무도장‘으로만 사용되었으며, 일반적으로 폭격을 승인하기 전에 각 대상에 대해 개인적으로 ’20초‘만 할애한다고 덧붙였다. 라벤더로 표시된 대상이 남성인지 확인하기 위해서였다. 이는 시스템이 약 10%의 경우 ’오류‘로 저지르고, 무장 단체와 느슨한 관계가 있거나 전혀 관계가 없는 개인을 가끔 표시하는 것으로 알려져 있다는 사실을 알고 있었음에도 불구하고 그렇게 했다. 할루시네이션을 무시한 것이다.

게다가 이스라엘군은 군사 활동 중이 아니라, 주로 밤에 온 가족이 있는 집에서 표적 개인을 체계적으로 공격했다. 이는 정보 관점에서 볼 때 개인을 개인 주택에서 찾는 것이 더 쉬웠기 때문이라고 한다. ”아빠 어디야?“는 시스템을 포함한 추가 자동화 시스템도 처음으로 공개되었는데, 이는 표적 개인을 추적하고 가족의 거주지에 들어갔을 때 폭격을 수행하는 데 특별히 사용됐다고 한다.

그 결과, 수천 명의 팔레스타인인(대부분이 여성과 어린이이거나 전투에 연루되지 않은 사람들)이 이스라엘 공습으로 전멸했다. 특히 AI 프로그램의 결정으로 인해 전쟁 초기 몇 주 동안 더 심했다.

한 이스라엘 정보 장교는 "우리는 (하마스) 요원들이 군 건물에 있거나 군사 활동에 참여하고 있을 때만 죽이는 데 관심이 없었다”면서 “반대로, IDF는 주저 없이 첫 번째 옵션으로 주택을 폭격했다. 가족의 집을 폭격하는 것이 훨씬 쉽다. 이 시스템은 이런 상황에서 그들을 찾도록 만들어졌다.

라벤더 머신은 또 다른 AI 시스템인 ”더 가스펠(The Gospel)“에 합류했는데, 이 시스템에 대한 정보는 2023년 11월 이전 조사와 이스라엘 군대의 자체 간행물 에서 밝혀졌다. 두 시스템의 근본적인 차이점은 대상의 정의에 있다. 가스펠은 군대가 무장 세력이 활동한다고 주장하는 건물과 구조물을 표시하는 반면, 라벤더는 사람을 표시하고 사살 목록에 올린다.

라벤더가 표시한 것으로 추정되는 ’하급 무장 세력‘을 표적으로 삼을 때, 군은 일반적으로 ’멍청한 폭탄‘(dumb bombs/ 스마트 정밀 폭탄-smart” precision bomb과 대조적으로)으로 알려진 무(無)유도 미사일만 사용하는 것을 선호했다. 비싼 첨단 유도 미사일보다는 단순한 미사일 등을 하급 무장 세력에게 사용했다는 것으로, 살해하는 것도 계급에 따라 고가용, 저가 보급형으로 나뉘었다.

이 폭탄은 거주자 위에 있는 건물 전체를 파괴하고 상당한 사상자를 낼 수 있다. 정보 장교 중 한 명인 또 다른 요원은 “중요하지 않은 사람들에게 값비싼 폭탄을 낭비하고 싶지 않을 겁니다. 국가적으로 매우 비용이 많이 들고 (그런 폭탄이) 부족하거든”이라고 말했다. 또 다른 소식통은 라벤더가 표시한 것으로 추정되는 하급 요원의 ’수백 채‘의 개인 주택을 폭격하도록 개인적으로 허가했으며, 이러한 공격 중 많은 수가 ’부수적 피해‘로 민간인과 온 가족을 죽였다고 말했다.

이스라엘 군 당국은 또 ’1 대 15 법칙‘은 준용했다. 하마스 요원 1명을 살해하는 과정에서 민간인 15명(혹은 20명)까지 죽이는 것을 허용했다. 과거에는 이스라엘군은 하위 계급의 무장 세력을 암살하는 동안 어떠한 ’부수적 피해‘도 허가하지 않았다. 표적이 대대 또는 여단 사령관 계급의 하마스 고위 간부일 경우, 군은 여러 차례 한 명의 사령관을 암살하는 데 100명 이상의 민간인을 죽이는 것을 허가했다고 덧붙였다.

다음 조사는 가자 전쟁 초기 이스라엘군의 고도로 자동화된 표적 생산의 6가지 연대기적 단계에 따라 구성된다.

첫째, AI를 사용하여 수만 명의 팔레스타인인을 표시한 라벤더 기계 자체에 대해 설명한다. 둘째, 이러한 표적을 추적하고 이들이 가정에 들어왔을 때 군대에 신호를 보내는 “아빠 어디야?” 시스템을 공개한다.

셋째, 이러한 가정을 공격하기 위해 ’멍청한 폭탄‘이 어떻게 선택되었는지 설명한다.

넷째, 우리는 군대가 목표물 폭격 중에 죽일 수 있는 민간인의 허용 수를 어떻게 느슨하게 했는지 설명한다.

다섯째, 우리는 자동화된 소프트웨어가 각 가구의 비전투원 수를 어떻게 부정확하게 계산했는지 알아본다.

여섯째, 우리는 여러 차례 집이 폭격받았을 때, 대개 밤에, 개별 목표물이 전혀 안에 없었던 적이 있었는지 보여주었다. 군 장교들이 실시간으로 정보를 확인하지 않았기 때문이다.

이스라엘 군대에서 ’인간 표적(human target)‘이라는 용어는 과거에 군 국제법 부서의 규칙에 따라 민간인이 주변에 있어도 개인 주택에서 살해할 수 있는 고위 군 요원을 지칭했다. 정보원들은 이스라엘의 이전 전쟁에서는 이것이 누군가를 죽이는 ’특히 잔인한(especially brutal)‘ 방법이었기 때문에(종종 표적과 함께 온 가족을 죽이는 방식) 이러한 인간 표적은 매우 신중하게 표시되었다고 한다.

하지만 10월 7일 이후 하마스가 이끄는 무장 세력이 이스라엘 남부 지역 사회에 치명적인 공격을 가해 약 1,200명을 죽이고 240명을 납치한 후, 군은 극적으로 다른 접근 방식을 취했다고 소식통은 전했다. “철의 검 작전(Operation Iron Swords)”에 따라 군은 계급이나 군사적 중요성에 관계없이 하마스 군사 조직의 모든 요원을 인간 표적으로 지정하기로 결정했다. 그것이 모든 것을 바꾸어 버렸다.

새로운 정책은 또 이스라엘 정보부에 기술적 문제를 야기했다. 이전 전쟁에서 단일 인간 표적의 암살을 승인하기 위해 장교는 복잡하고 긴 ’범죄 입증 과정(incrimination process)‘을 거쳐야 했다. 즉, 그 사람이 실제로 하마스 군사 조직의 고위 구성원이라는 증거를 교차 확인하고, 그가 어디에 살고 있는지, 연락처 정보를 알아내고, 마지막으로 그가 언제 집에 있는지 실시간으로 알아내는 것이다. 표적 목록이 고위 요원 몇십 명에 불과할 때, 정보 인력은 개별적으로 범죄 입증 및 위치 파악 작업을 처리할 수 있었다.

그러나 명단이 수만 명의 하위 요원을 포함하도록 확대되자 이스라엘군은 자동화된 소프트웨어와 인공지능에 의존해야 한다고 생각했다. 그 결과, 팔레스타인인을 군사 요원으로 기소하는 데 있어 인간이 하는 역할은 제쳐두고 대신 AI가 대부분의 작업을 수행했다. 매체와 인터뷰한 4명의 소식통에 따르면, 현재 전쟁에서 인간을 표적으로 삼기 위해 개발된 라벤더는 약 37,000명의 팔레스타인인을 암살 대상으로 의심되는 "하마스 무장 세력"으로 표시했으며, 대부분이 하급이었다. 그러나 이스라엘 방위군(IDF) 대변인은 성명에서 그러한 사살 명단의 존재를 전면 부인했다.

이전에 보조 도구로만 사용되었던 라벤더의 사살 목록을 자동으로 채택하도록 승인한 것은 정보 요원들이 AI 시스템이 선택한 수백 개의 무작위 표본의 정확도를 ’수동으로‘ 확인한 후 전쟁이 시작된 지 약 2주 후에 이루어졌다고 한다. 그 표본에서 라벤더의 결과가 하마스와 관련된 개인의 식별에서 90%의 정확도에 도달했다는 것을 발견했을 때, 군은 이 시스템의 광범위한 사용을 승인했다.

그 순간부터 라벤더가 개인이 하마스의 무장 세력이라고 판단하면, 기본적으로 그것을 명령으로 취급하라는 요청을 받았으며, 기계가 왜 그런 선택을 했는지 독립적으로 확인하거나 그 선택의 근거가 되는 원시정보 데이터를 검토할 필요가 없었다.

전쟁 초기에 제한을 완화한 것의 치명적인 결과는 엄청났다. 이스라엘군이 전쟁이 시작된 이래로 거의 전적으로 의존해 온 가자지구의 팔레스타인 보건부의 데이터에 따르면, 이스라엘은 전쟁이 시작된 지 6주 만에 약 15,000명의 팔레스타인인을 죽였다. 이는 지금까지 사망자의 거의 절반에 해당한다. 11월 24일에 1주일간의 휴전에 합의할 때까지 그 많은 사망자를 발생시켰다.

라벤더 소프트웨어는 가자 지구에 거주하는 230만 명의 주민 대부분에 대해 수집된 정보를 대규모 감시 시스템을 통해 분석한 다음, 각 개인이 하마스 또는 팔레스타인 이슬람 성전(PIJ)의 군사 조직에서 활동할 가능성을 평가하고 순위를 매기고, 이 기계는 가자 지구에 있는 거의 모든 사람에게 1에서 100까지의 등급을 매겨 그들이 무장 세력일 가능성을 표현했다고 한다.

라벤더는 알려진 하마스와 PIJ 요원의 특징을 식별하는 법을 배우고, 그 정보는 기계에 훈련 데이터로 입력된 다음, 일반 대중 사이에서 동일한 특징을 찾는 법을 배웠다고 한다. 여러 가지 다른 유죄 특징을 가진 것으로 밝혀진 개인은 높은 평가를 받게 되며, 따라서 자동으로 암살의 잠재적인 표적이 되는 시스템이다. 할루시네이션과 더불어 오류가 많을 수밖에 없다.

초기에는 인간에 의한 조종으로 시작된 것이, 상황이 급해지면서 오히려 AI를 맹종하고 전적으로 의존하는 바람에 데이비드 캐머런 전 영국 총리가 말했던 것처럼 ’세계에서 가장 큰 야외 감옥‘은 이제 “죽음의 수용소(death camp)”로 변해버렸다.

이스라엘은 반(反)인도적, 반(反)인륜적 전쟁을 베냐민 네타냐후의 통치 권력의 유지와 이를 지원하는 미국 정치권의 합작품으로 만들어지고 있으며, 천부인권(天賦人權), 민주주의 가치는 그저 구호에 불과하다. 실질적으로는 대량 학살(genocide)을 유발하며 범죄 행위가 당연한 것처럼 진행되고 있다. 양두구육(羊頭狗肉)의 모순덩어리 세계이다.

뉴스타운

뉴스타운TV 구독 및 시청료 후원하기

뉴스타운TV

![[단독] 북한산 인수봉, 구조 헬기 긴급 출동 장면 포착!](/news/photo/202511/669971_628773_447.jpg)