미국의 오픈AI(OpenAI)는 “일부 사람들이 실제와 같은 챗지피티(ChatGPT) 음성 모드에 감정적으로 의존하게 될 수 있다”고 경고했다고 ‘더 힐’이 8일(현지시간) 보도했다.

OpenAI는 8일 보고서를 통해 인기 있는 인공지능 도구인 ChatGPT와 사람처럼 들리는 새로운 음성 모드에서 수행한 안전 작업에 대한 정보를 공개했다.

CNN이 최초로 보도한 바에 따르면, OpenAI는 지난주에 유료 고객을 대상으로 “GPT-4o”를 출시하기 시작했다.

이 회사는 지난 5월 시연에서 최신 기술을 공개했다. 실시간 대화 중에 두 대화자 사이에서 번역할 수 있고, 셀카를 기반으로 사람의 감정을 감지할 수도 있다. 오픈 AI는 새로운 오디오 기술이 대화자 식별, 무단 음성 생성 등을 포함한 ‘새로운 위험’을 초래한다고 밝혔다.

이 기술은 232밀리초(milliseconds) 이내에 오디오 입력에 응답할 수 있는데, 이는 대화에서 사람이 반응하는 시간과 비슷하다고 회사 측은 밝혔다.

오픈AI는 인간과 유사한 행동을 인간이 아닌 존재에 부여하는 ‘의인화(anthropomorphization)의 위험성’이 이 도구의 오디오 기능으로 인해 높아진다고 밝혔다. 이는 인간과 더 유사한 상호 작용이 가능하기 때문이다.

OpenAI는 보고서에서 초기 테스트에서 사용자들이 기술과 연결을 형성하고 있음을 나타낼 수 있는 언어를 사용했다고 밝혔다.

회사 측은 “이러한 사례는 긍정적으로 보이지만, 이러한 효과가 장기간에 걸쳐 어떻게 나타날 수 있는지에 대한 지속적인 조사가 필요하다는 신호”라고 밝혔다.

사용자는 또 인간 상호 작용에 대한 필요성이나 욕구를 감소시키는 기술과 관계를 형성할 수 있다. 회사는 외로운 개인에게 이로울 수 있지만 ‘건강한 관계’에 영향을 미칠 수 있다고 말했다.

OpenAI는 이 기술이 사용자를 위해 작업을 완료하고 대화에 대한 세부 정보를 기억하는 능력을 통해 “매력적인 제품 경험과 과도한 의존 및 의존의 가능성”을 모두 만들어 낼 수 있다고 밝혔다.

이 기술은 2013년 영화 “Her”와 비교됐다. 영화에서 캐릭터의 목소리를 맡은 배우 스칼렛 요한슨은 OpenAI의 목소리 중 하나에 이의를 제기하며, 자신의 목소리와 ‘소름 돋을 정도로 비슷하다’ 고 말했다.

뉴스타운

뉴스타운TV 구독 및 시청료 후원하기

뉴스타운TV

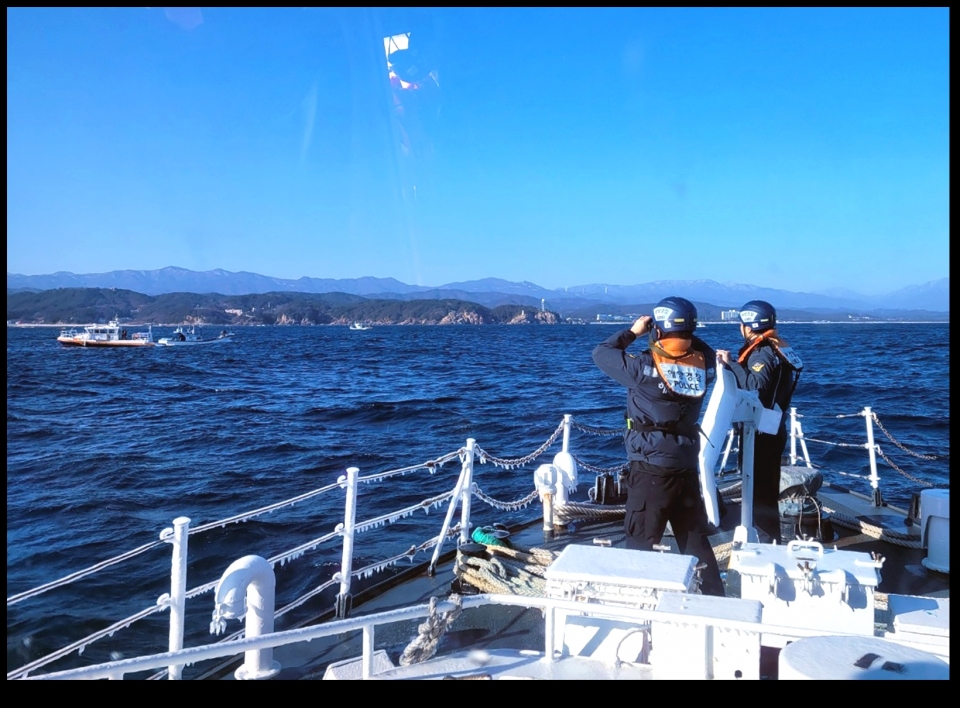

![[단독] 북한산 인수봉, 구조 헬기 긴급 출동 장면 포착!](/news/photo/202511/669971_628773_447.jpg)